开云体育

开云体育官方DeepSeek开源周揭示训练成本真相AI界的效率革命!

在人工智能的精彩舞台上,DeepSeek这位新晋明星毫无疑问地引起了全行业的关注。近日,DeepSeek开放了一个开源周活动,持续五天,先后推出了多个引人瞩目的项目,宛如一场高能科技盛宴。对此,Dragonscale Industries的CTO Stephen Pimentel表示:“DeepSeek有效地驳斥了那些指责其训练夸大的言论。”

自2月24日至28日,三天内深度探索的开发者们纷纷见证了DeepSeek的实力。Day1推出了FlashMLA,一个针对NVIDIA Hopper架构GPU的高效多头潜在注意力解码内核,Day2则推出了DeepEP,这是首个支持混合专家 (MoE) 模型的开源通信库,而Day3公布的DeepGEMM库,更是在压榨GPU性能上表现得淋漓尽致。

以DeepGEMM为例,它被称为“数学领域的超级英雄”,在GitHub上线个星标。这款库专注于FP8高效通用矩阵乘法,不仅提高了计算效率,还能在资源受限的情况下进行动态优化,展现出极强的适应能力。

值得一提的是,DeepGEMM支持NVIDIA Hopper张量核心,并以仅300行代码实现了复杂的计算逻辑,通过两级累积方法有效解决了FP8计算带来的精度问题。这种灵活性还得益于即时编译 JIT,使其能够在不同硬件上优化运行,呈现出极高的算力效率。

进一步追溯到之前开放的项目,FlashMLA在处理变长序列的推理时降低了延迟,提升了吞吐量,无论是聊天机器人、翻译服务还是语音助手,都能在这一技术的助力下迅速响应。而DeepEP致力于简化在复杂机器学习任务中的数据传输,实现“专家”模型之间的高效协作,宛如一位智慧的流量指挥官。

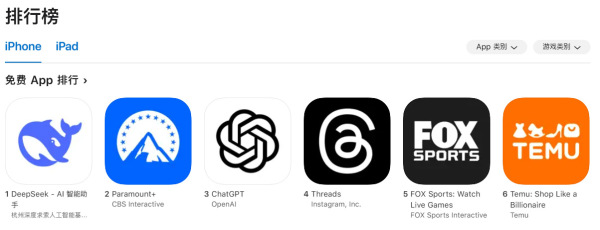

DeepSeek的开源周明显打击了早前对其高昂训练成本的质疑,被认为的虚假预算现已在实证面前一一驳回。去年12月DeepSeek曾透露,其V3模型的训练成本仅600万美元,而这远低于竞争对手的数十亿投入。此举让批评者无话可说,多个名流媒体对其开源技术无不赞赏,纷纷称其为“真正的OpenAI”。

DeepSeek的“科技浪漫”不仅体现在其产品和服务中,更在于所展示出的对待未来的有力态度。随着DeepSeek继续推进开源计划,期待AI领域的新创新将引领技术的更高峰。下一个精彩的章节,让我们拭目以待!返回搜狐,查看更多

2025-05-21

2025-05-21 浏览次数:

次

浏览次数:

次 返回列表

返回列表